即可将网页分享至朋友圈

英才学院秉承“自由、创新、博学、精进”的精神,构建了从大一到大四分阶段的“看科研、做科研、强科研、深科研”的科研训练体系,并与课程改革建设深度融合,引导学生走上学术研究道路。各个阶段任务清晰且贯通递进,坚持高端引领、学研融合、全员覆盖。

学院实施全程导师制,汇聚热爱教育、甘于奉献、学术造诣深厚、德才兼备的导师加入拔尖人才培养,多维度多领域引导开展学业与科研训练指导。大一阶段邀请有热情且乐于与新生交流的青年专家担任成长导师,继大一走进各大重点实验室科研团队“看科研”观摩交流活动后,大二到大四分别设置“基础科研训练I”、“基础科研训练II”、“综合科研训练”作为必修课程进入培养方案,全体学生自由选择科研导师连续三年开展递进式的科研训练。

在系统的科研训练机制下,同学们在通信、电子、计算机、人工智能、自动化、机电、光电、航空、生物、医学等各领域进行成体系的训练,并开展交叉研究,每年产出高水平研究成果,增强了自信,强有力支撑他们直博深造从事科学研究的信心。2024年截止到目前,英才学子中已有29篇研究成果产生,表现出同学们良好的研究创新思维和能力。

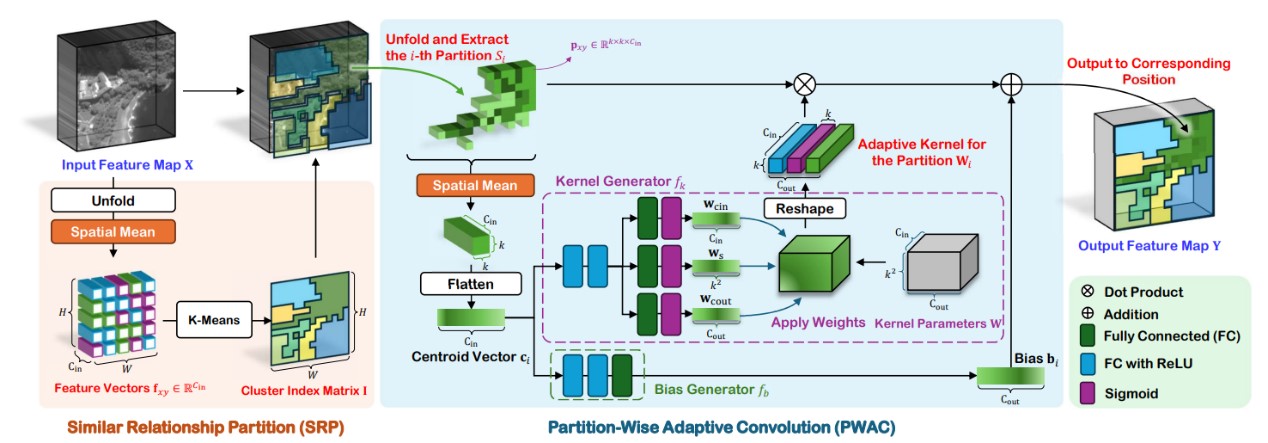

表1 英才学院2024 年部分研究成果发表情况

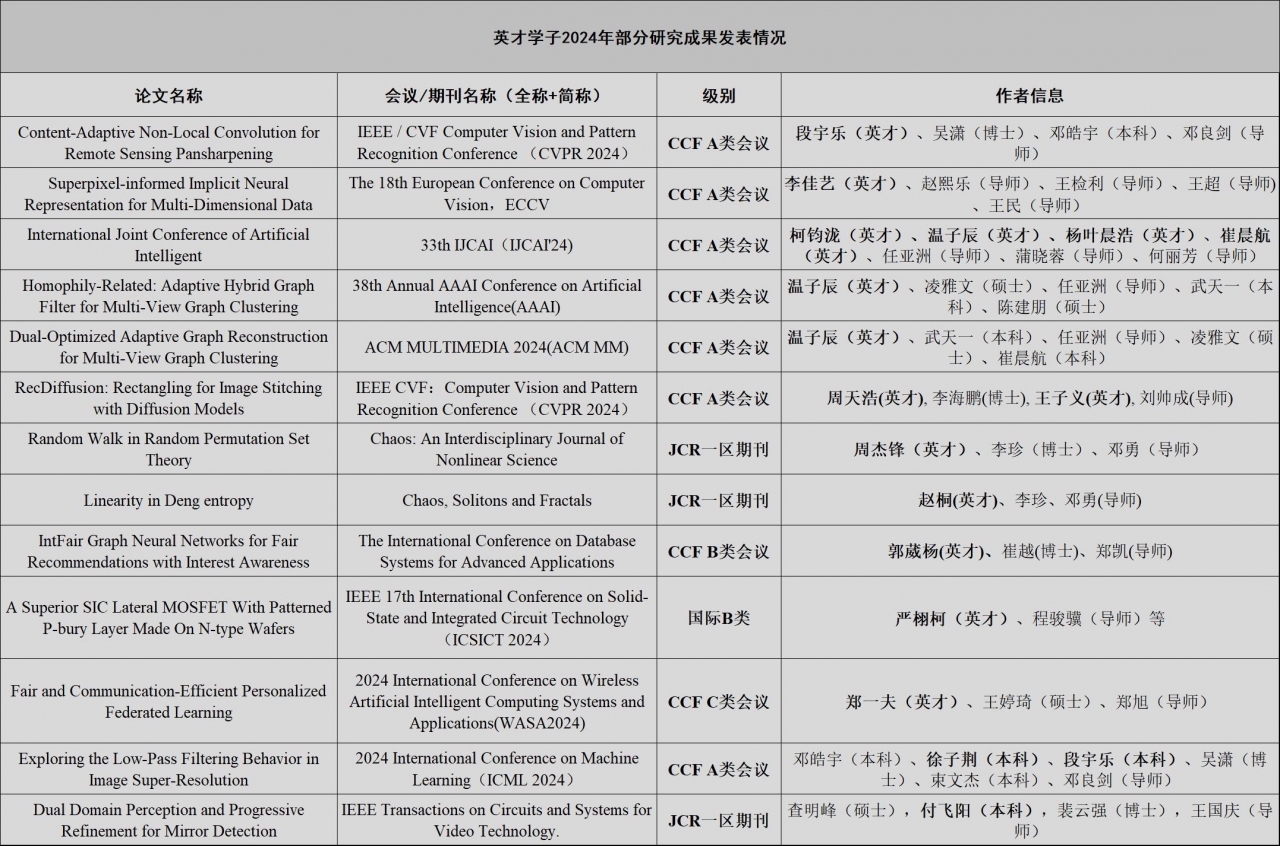

段宇乐:在机器学习领域CCF-A类会议CVPR发表成果并参会

2021级本科生段宇乐在邓良剑老师课题组科研训练期间,以共一作者身份撰写的论文“Content-Adaptive Non-Local Convolution for Remote Sensing Pansharpening”入选计算机视觉和机器学习领域CCF-A类会议CVPR,数学学院邓良剑教授为通讯作者,他于6月17日赴美国西雅图参加该会议并进行海报展示。

图1.1 段宇乐参加国际会议CVPR

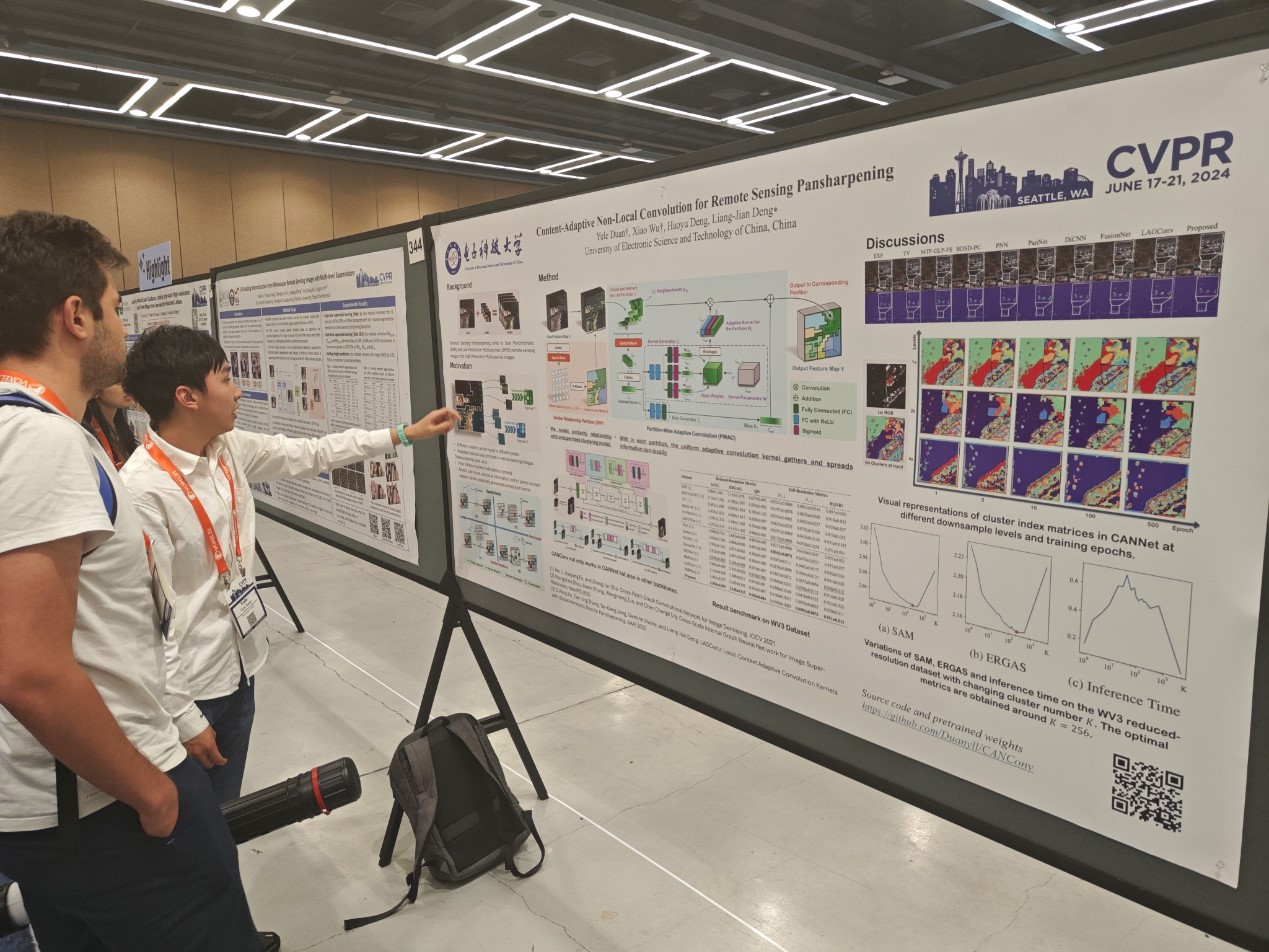

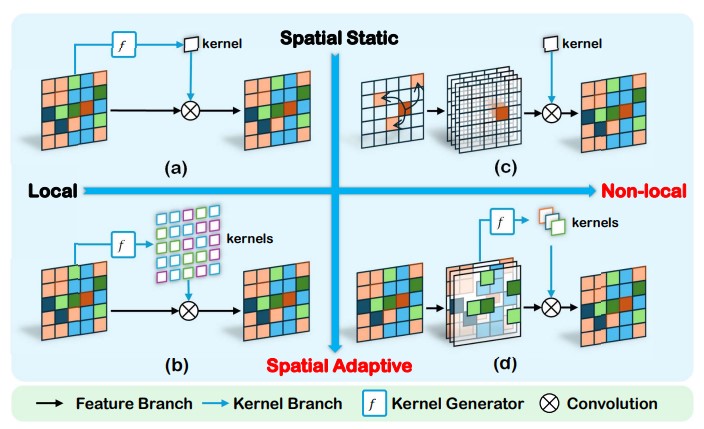

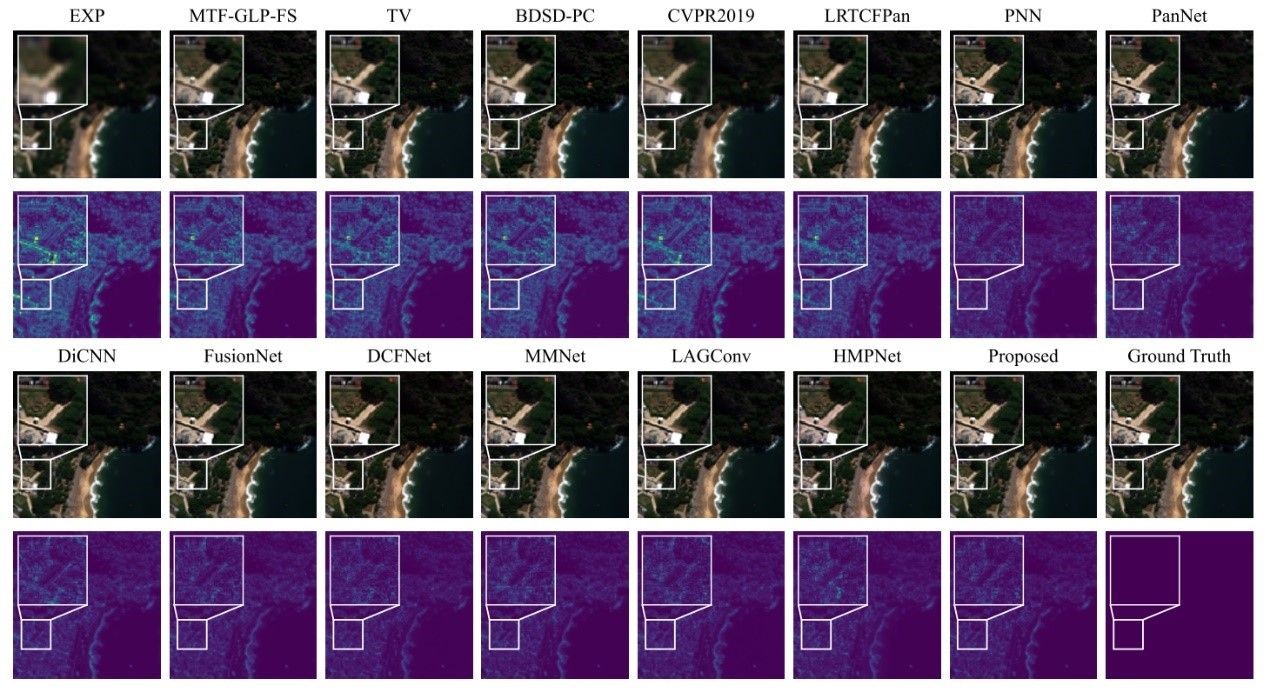

研究工作:基于机器学习的遥感融合方法发展迅速。然而,现有的融合方法通常没有充分利用非局部空间中的差异化区域信息(见图1.1),限制了方法的有效性,并导致了冗余的学习参数。为了克服现有方法的局限性,作者设计了针对遥感影像融合任务特点的内容自适应非局部卷积(CANConv)方法。CANConv通过内容自适应卷积实现了空间自适应性,并利用非局部的自相似信息,包含两个子模块:相似关系划分(SRP)和分区自适应卷积(PWAC)。论文的主要贡献如下:1.提出了CANConv模块,利用自适应卷积同时结合空间自适应性和非局部自相似性(见图1.2),在CANConv模块的基础上设计了CANNet网络,能够利用多尺度的自相似信息。2.分析了遥感图像中普遍存在的非局部自相似关系,并通过可视化和讨论实验证明了CANConv模块的理论有效性。3.在多个遥感融合数据集上,通过与各种融合方法的对比(见图1.3),验证了CANConv方法。结果表明,CANConv达到了当前最先进的性能水平。

图1.2 论文提出的CANConv方法与原有方法的比较

图1.3 CANConv模块的整体工作流程

图1.4 CANConv与多种现有方法在WorldView-3数据集上的可视化结果对比

周天浩:在机器学习领域CCF-A类会议CVPR发表成果并参会

2022级本科生周天浩在刘帅成老师课题组科研训练期间,以共一作者的身份撰写的论文“RecDiffusion: Rectangling for Image Stitching with Diffusion Models”入选计算机视觉和机器学习领域CCF-A类会议CVPR。信息与通讯工程学院刘帅成教授为通讯作者,电子科技大学为第一作者和通讯作者单位。

图2.1 周天浩参加国际会议CVPR

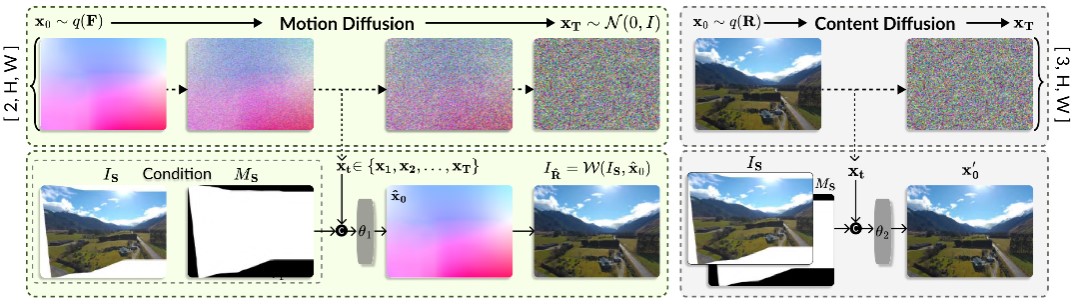

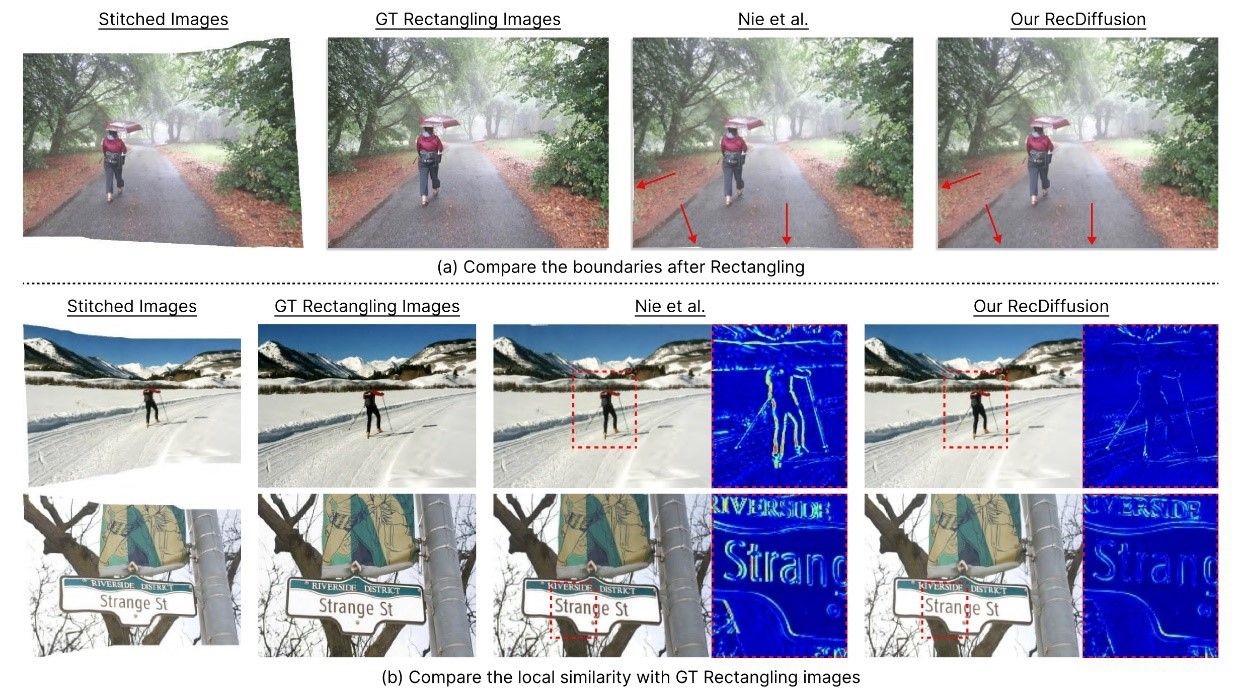

研究工作:将图像进行拼接往往会产生非矩形边界,为解决此问题,目前的解决方案包括裁剪(会丢弃图像内容)、填充(会引入无关内容)或扭曲(会扭曲非线性特征并引入伪影)。为了克服这些问题,本工作为拼接图像矩形化引入了一种基于扩散的新型学习框架。 该框架结合了运动扩散模型(MDM)来生成运动场,有效地从拼接图像的不规则边界过渡到几何校正的中间图像。 随后是内容扩散模型(CDM)用于细化图像细节。此工作所提出的方法可确保几何精度和整体视觉效果,在公共的基准评估中,无论是定量还是定性指标,都超越了以往所有方法。

本工作的贡献可以概括如下:1.提出了第一个基于扩散的图像拼接框架,即RecDiffusion。2.提出了通过一个运动扩散模型(MDM)来生成拼接运动场,然后提出了一个内容扩散模型(CDM)来细化图像细节的矩形化处理方法。3.大量实验表明,本工作提出的方法在公共基准上与传统的和深度的方法相比,达到了最先进的性能。

图2.2 本文提出的RecDiffusion的训练流程示意图

图2.3 RecDiffusion在DIR-D数据集上与其他方法的可视化对比

李佳艺:在计算机视觉领域CCF-A类会议ECCV发表成果

2021级本科生李佳艺同学在数学学院赵熙乐教授指导下,与西南交通大学王检利助理教授、南方科技大学王超教授、江西财经大学王民教授等合作,以第一作者身份撰写的论文"Superpixel-informed Implicit Neural Representation for Multi-Dimensional Data"被计算机视觉领域CCF-A类会议ECCV录用。

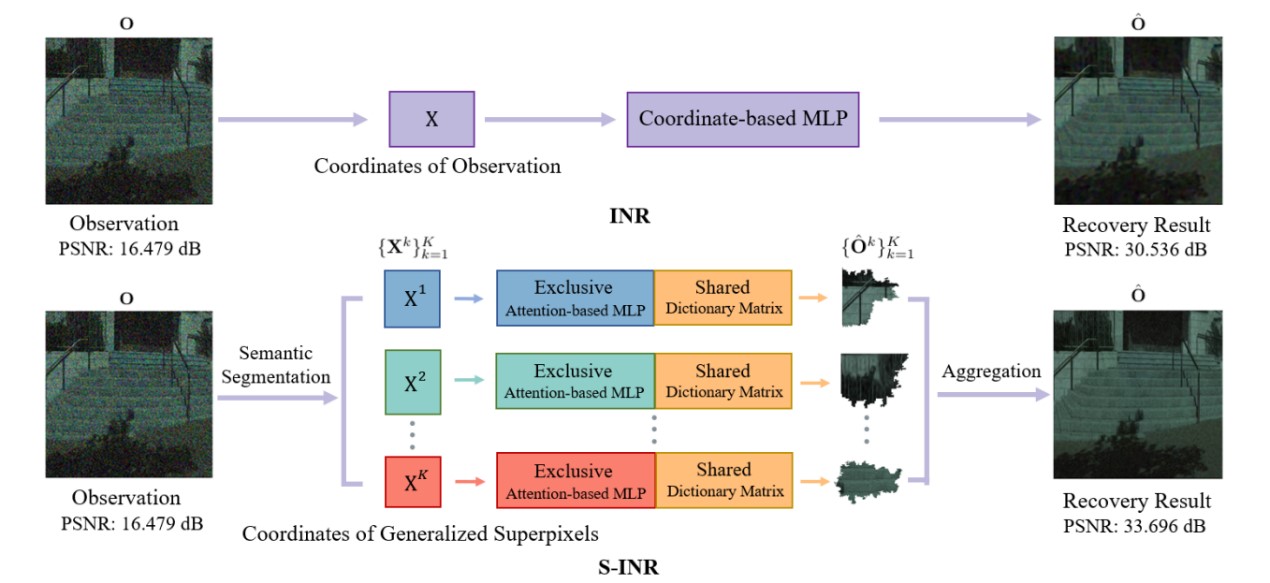

研究工作:隐式神经表示(INR)是近年来表示多维数据的重要方法,在图像、点云、视频和音频信号等领域获得了广泛应用。然而,传统的INR方法往往忽略了数据中丰富的内在语义信息。针对这一问题,研究团队创新性地提出了一种基于超像素的隐式神经表示(S-INR)方法。该方法首次提出使用广义超像素替代传统像素作为INR的基本单元,并通过精心设计的基于注意力机制的MLP和共享字典矩阵两个关键模块,实现了对数据语义信息的有效利用。

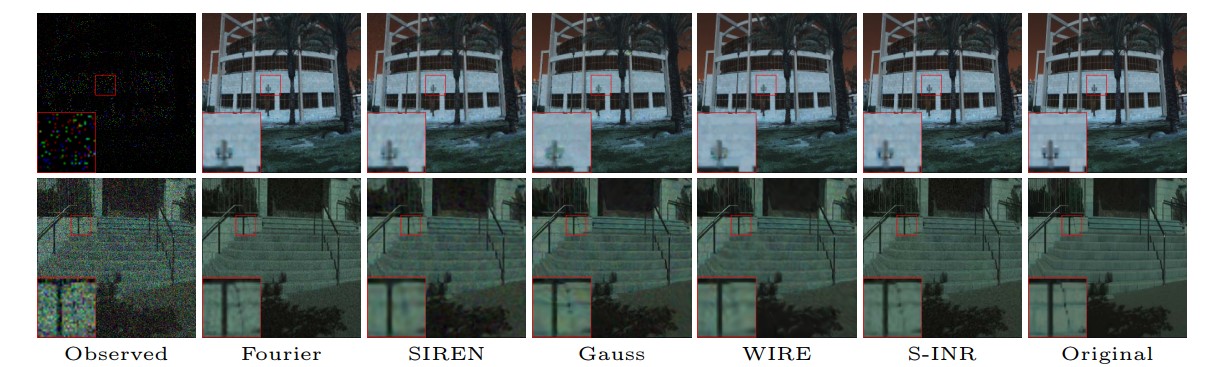

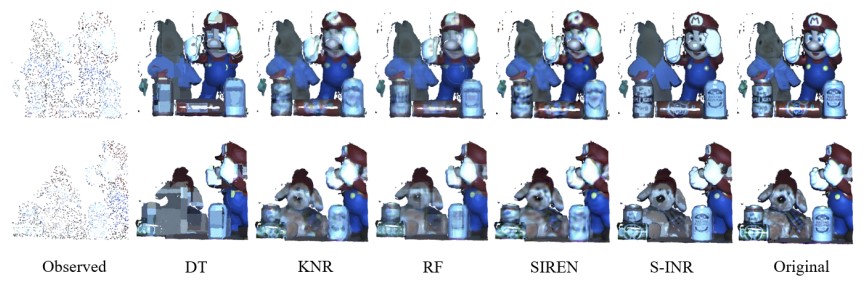

该研究的主要创新点包括:首次将广义超像素概念引入INR框架,使其不仅适用于图像数据,还可应用于更广泛的点数据处理;开发了创新的S-INR方法,通过独特的模块设计实现了超像素内部和超像素之间语义信息的充分利用。研究团队在高光谱图像去噪、补全重建,以及点云和气候数据的补全等多个任务上进行了广泛实验,结果表明S-INR方法在表达能力和鲁棒性方面均显著优于现有最先进的INR方法。

这项研究不仅在理论上拓展了INR的应用边界,更为多维数据处理提供了新的研究思路和方法。该成果展示了我校在人工智能和数据科学领域的研究实力,也体现了跨校际合作研究的重要价值。李佳艺同学在赵熙乐教授的指导下,通过与多所高校的研究人员合作,成功完成了这项具有重要学术价值的研究工作,展现了我校学生在科研创新方面的优秀能力。

图3.1 传统INR和我们提出的超像素信息INR(S-INR)在图像去噪任务上的整体处理说明。在提出的S-INR中,广义超像素被用作基本单位。广义超像素的坐标被输入到基于注意力机制的MLP中,然后中间结果与共享字典矩阵交互以获得恢复结果。

图3.2 不同方法在数据集Mor和Lehavim上的图像补全和图像去噪结果

图3.3 不同方法在采样率为0.025的3D表面数据Scene1、Scene2和Scene3上的3D表面补全恢复结果

严栩柯:在半导体领域会议IEEE ICSICT发表研究成果

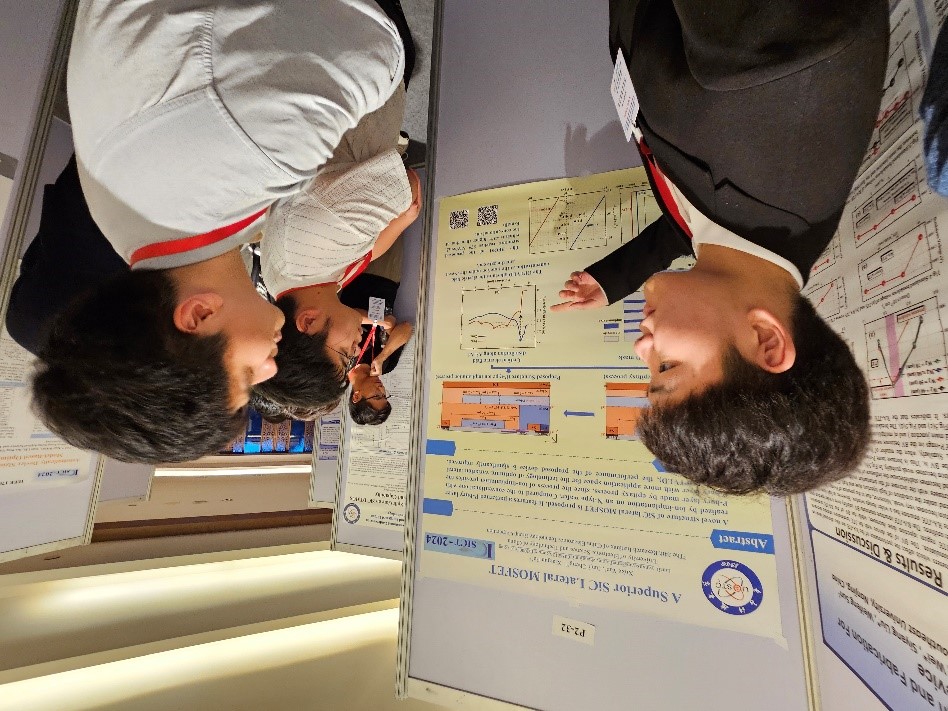

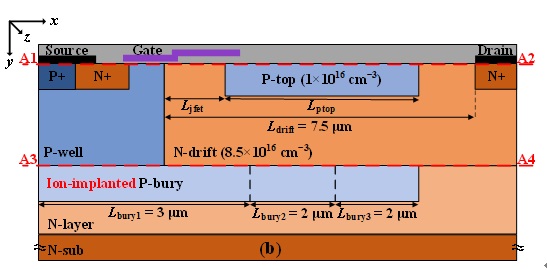

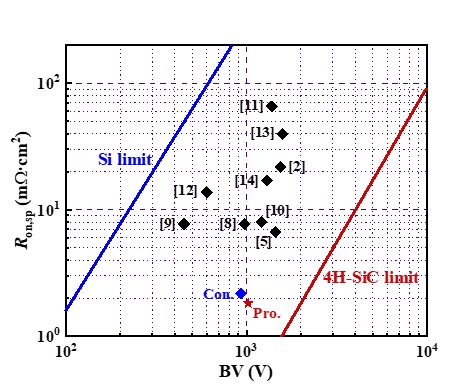

2021级本科生严栩柯在程骏骥老师课题组科研训练期间,撰写的论文“A Superior SiC Lateral MOSFET with Patterned P-bury Layer Made on N-type Wafers”成功入选半导体领域国际会议之一的International Conference on Solid-State and Circuit Technology(IEEE ICSICT,国际固态和集成电路技术会议)。严栩柯为该论文第一作者,集成电路科学与工程学院程骏骥副教授为通讯作者,电子科技大学为第一作者单位和通讯作者单位。严栩柯于10月22日赴珠海参加该会议并进行海报展示。

图4.1 严栩柯在ICSICT会议上介绍工作

研究工作:SiC基功率器件发展迅速,然而部分工艺质量问题和材料高成本问题限制其进一步投入应用。该论文针对工艺实现问题,运用特殊设计的掩模版(如图4.2所示),通过离子注入制作了具有更高质量的P型SiC埋层。根据OPTVLD原理,对埋层进行图形化设计,结合DOUBLE RESURF原理大大缓解了器件表面原有的电场尖峰,部分效果如图4.3所示,从而实现了器件性能优化。在工艺改进的前提下,实现了器件优值的进一步提升。

图4.2 提出器件结构图

图4.3 研究结果与同类型研究对比图

英才学子们在科研训练的道路上勤于专研、勇于挑战,不断有成果产出,不仅仅是优秀的同学们自身的努力和创新智慧的结晶,更是优秀导师们的精心指导和辛勤付出的体现。同学们利用英才学院提供的平台找到了自己喜欢的科研方向,也将在未来在科研道路上自由充分探索,开阔视野,培养能力,不断提高科研实力,绽放思想火花。

编辑:刘瑶 / 审核:李果 / 发布:陈伟